Recentemente, Amazon ha lanciato il suo chatbot AI Amazon Q, suscitando interesse da parte delle aziende ma anche preoccupazioni tra i dipendenti per gravi problemi di accuratezza e privacy. Q è stato segnalato per aver “allucinazioni di non poco conto” e divulgato dati confidenziali, sollevando interrogativi sulla sicurezza delle informazioni aziendali. Ecco i dettagli divulgati da Platformer.

Allarme sicurezza per Amazon Q: tra dati riservati e risposte errate

Amazon ha introdotto il suo chatbot AI, denominato Q, tre giorni fa, ma non tutto sembra procedere come previsto. Alcuni dipendenti hanno lanciato l’allarme su questioni di accuratezza e privacy: Amazon Q avrebbe manifestato “allucinazioni” e rivelato informazioni riservate, come la posizione dei centri dati AWS, programmi di sconto interni e funzionalità non ancora rilasciate.

Queste informazioni sono emerse da documenti trapelati e ottenuti da Platformer, evidenziando un problema di sicurezza di livello 2, una situazione grave che richiede interventi urgenti degli ingegneri.

Nonostante ciò, Amazon ha minimizzato l’importanza di queste discussioni interne. Un portavoce ha affermato che la condivisione di feedback attraverso canali interni è una prassi standard in Amazon e che non sono stati identificati problemi di sicurezza a seguito di questo feedback. La società ha sottolineato l’importanza del feedback ricevuto e la volontà di continuare a perfezionare Amazon Q durante la sua transizione dalla fase di anteprima alla disponibilità generale.

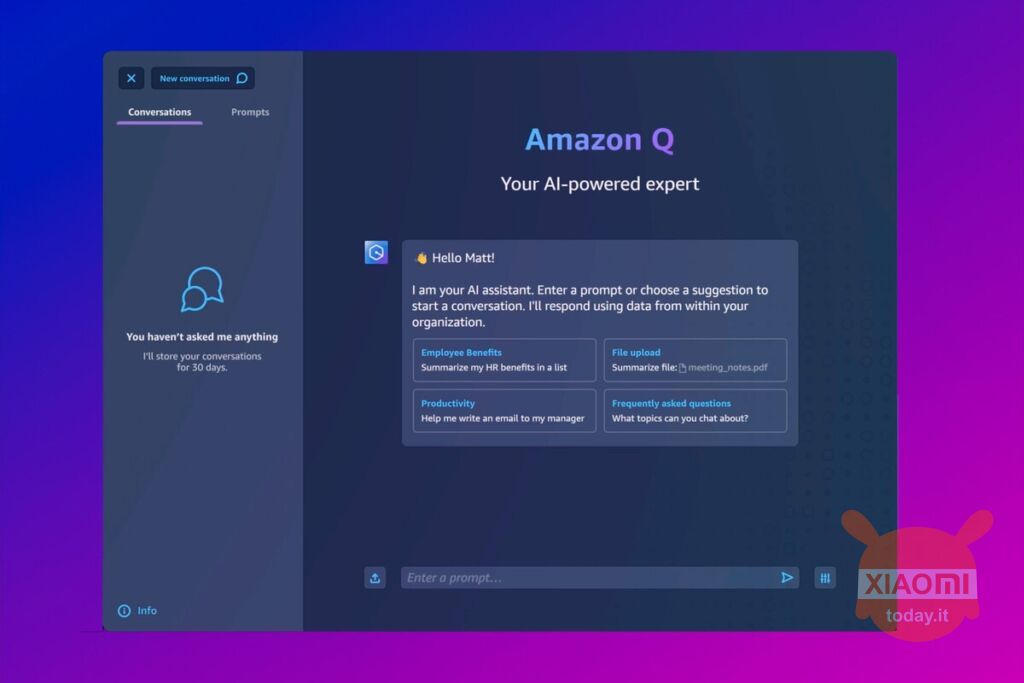

Amazon Q, attualmente disponibile in un’anteprima gratuita, è stato presentato come una versione software aziendale di un chatbot, con funzioni iniziali volte a rispondere a domande degli sviluppatori su AWS, modificare codici sorgente e citare fonti. Amazon ha enfatizzato la sicurezza e la privacy di Q, contrapponendolo agli strumenti consumer-grade come ChatGPT.

Tuttavia, un documento interno ha rivelato che Q può “allucinare” e fornire risposte dannose o inappropriate, come informazioni di sicurezza obsolete che potrebbero mettere a rischio gli account dei clienti. Questi rischi sono tipici dei grandi modelli di linguaggio, che tutti tendono a fornire risposte scorrette o inappropriate almeno in alcune occasioni.

Via | Slashdot